Grote verschillen tussen peilers

Op 21 januari 2015 kwam de nieuwe editie van Peilingwijzer uit (http://peilingwijzer.tomlouwerse.nl/). Die peiling combineert vier verschillende peilingen: de Politieke Barometer van Ipsos, Peil.nl van Maurice de Hond, De Stemming van EénVandaag en TNS-NIPO. Wat opviel was dat er nogal wat verschillen waren tussen die peilingen. De verschillen zijn zo groot dat ze niet meer kunnen worden geschreven aan de onzekerheid die je altijd hebt bij het trekken van steekproeven. De vraag is nu: hoe komt het dat die verschillen zo groot zijn?

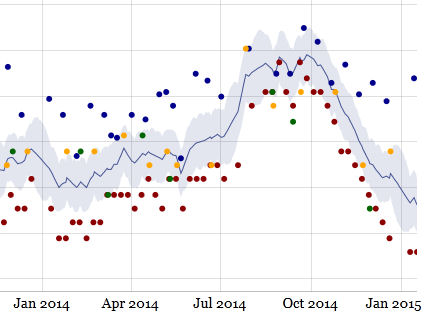

De figuur hieronder toont de voorspellingen voor het aantal zetels voor de VVD in het afgelopen jaar. De grafiek komt van de website van de Peilingwijzer. Duidelijk is te zien dat blauwe stippen van de Politieke Barometer (Ipsos) systematisch hoger liggen dan de rode stippen van Peil (Maurice de Hond). En in de eerste weken van het nieuwe jaar worden die verschillen alleen maar groter. Bij de laatste peiling van beide bureaus is het verschil maar liefst 12 zetels.

De VVD is niet de enige partij met erg grote verschillen. De grafiek hieronder bevat de voorspelling van het aantal zetels voor alle partijen in de laatste peiling van beide peilers. Voor Peil is gemeten op 16 en 17 januari en voor de Politieke Barometer op 13 t/m 15 januari.

Het grootste verschil is te zien bij de VVD. Volgens Peil krijgt deze partij 17 zetels en volgens de Politieke Barometer zijn het er 29. Een verschil van 12 zetels dus! Ook bij de PVV is er een verschil. Peil denkt dat deze partij 31 zetels krijgt en de Politieke Barometer denkt dat het er maar 25 zijn. Verder geeft Peil 23 zetels aan het CDA terwijl de Politieke Barometer uitkomt op slechts 17. Ten slotte is e rook nog een flink verschil bij GroenLinks. Peil denkt dat deze partij op 9 zetels krijgt terwijl de Politieke Barometer maar net iets hoger komt dan de helft (5 zetels).

Het zou mooi zijn als meer duidelijkheid kwam over deze verschillen. Beide peilers publiceren niet uitbundig veel informatie over hun peilingen. Dus daaruit valt geen verklaring te halen. Misschien kan een onafhankelijke commissie van deskundigen er eens naar kijken. Voorlopig moeten we er dus naar raden. Hier zijn een paar mogelijke oorzaken:

- Beide bureaus werken met een web-panel. Die web-panels zijn niet verkregen via een aselecte steekproef uit de Nederlandse bevolking. Je kunt je dus afvragen of die panels wel helemaal representatief zijn.

- Beide bureaus zullen werken met verschillende vragenlijsten. De volgorde van de vragen en de formulering van de vragen steken zeer nauw. Verschillen in vragen kunnen makkelijk verschillen in antwoorden veroorzaken.

- Beide bureaus zullen te maken hebben met non-respons in hun peilingen. Die non-respons kan de representativiteit van de peiling aantasten. De non-responspatronen hoeven niet bij beide peilers hetzelfde te zijn.

- Beide bureaus zullen een weging uitvoeren om voor eventuele afwijkingen van representativiteit te corrigeren. Als beide peilers andere correctieprocedures hanteren, kunnen de uitkomsten ook anders zijn.

- Beide peilingen zijn niet exact op hetzelfde moment uitgevoerd. Als er zich tussen de twee tijdstippen belangrijke politieke gebeurtenissen voordoen, dan zouden die kunnen leiden tot een wijziging van politieke opinie. Hier is het verschil maar een dag of twee en daarin is niets bijzonders gebeurd.

Ondertussen blijven we zitten met de vraag wat we met die verschillende peilingen aan moeten. Welke is peiling is goed en welke is niet goed? Of zijn ze misschien allebei niet goed?